[Python] OpenAI o1をAPI経由で使用する方法

9月13日時点ではベータ版であり、アカウントティアがティア5にのみAPIが解放されています。ティア5になるためには、アカウント作成から30日経過かつ$1000以上の課金が必要です。

OpenAI o1をAPI経由で使用するには、まずOpenAIのPythonクライアントをインストールし、APIキーを取得する必要があります。

次に、OpenAIクラスをインポートし、クライアントを初期化します。

chat.completions.createメソッドを使用して、モデルに対するリクエストを作成します。

このメソッドには、使用するモデル(例: “o1-preview”)と、ユーザーからのメッセージを含むリストを渡します。

応答はresponse.choices[0].message.contentで取得できます。

APIの利用には、レート制限やベータ版の制限事項に注意が必要です。

OpenAI o1とは

OpenAI o1の概要

OpenAI o1は、複雑な推論を行うために強化学習を用いて学習された新しい大規模言語モデルです。

このモデルは、ユーザーに応答する前に長い内部思考の過程を生み出すことができるため、科学的な推論に優れています。

具体的には、競技プログラミングの問題や数学オリンピックの予選で高い成績を収めており、物理学や生物学、化学の問題においても人間の博士レベルの精度を上回る成績を達成しています。

o1モデルの特徴

o1モデルには、以下のような特徴があります。

- 推論能力の向上: o1は「推論トークン」を使用して、プロンプトの理解を分解し、複数のアプローチを検討しながら応答を生成します。

これにより、深い推論が求められるタスクにおいて優れた性能を発揮します。

- 高い精度: 科学的な問題や競技プログラミングにおいて高い精度を示し、特に複雑な問題に対する解決能力が向上しています。

- 大規模なコンテキストウィンドウ: o1-previewは32,768トークン、o1-miniは65,536トークンのコンテキストウィンドウを提供し、長い文脈を保持しながら推論を行うことが可能です。

o1と他のモデルの違い

o1モデルは、他のモデルと比較して以下の点で異なります。

- 推論プロセス: o1は「推論トークン」を導入し、内部での思考プロセスを強化しています。

これにより、単なる応答生成ではなく、深い推論を行うことが可能です。

- 応答時間と精度のバランス: o1は深い推論を行うため、応答時間が長くなることがありますが、その分精度が高くなります。

これに対し、GPT-4oやGPT-4o-miniは一貫した高速な応答時間を提供します。

- ユースケースの適合性: o1は、深い推論が求められるアプリケーションに適しており、画像入力やFunction Callingが必要な場合にはGPT-4oが推奨されます。

これらの特徴により、o1は特定のユースケースにおいて非常に効果的な選択肢となります。

APIの準備

OpenAI o1をPythonで利用するためには、APIの準備が必要です。

以下では、APIキーの取得方法、Pythonクライアントのインストール、環境設定と初期化について説明します。

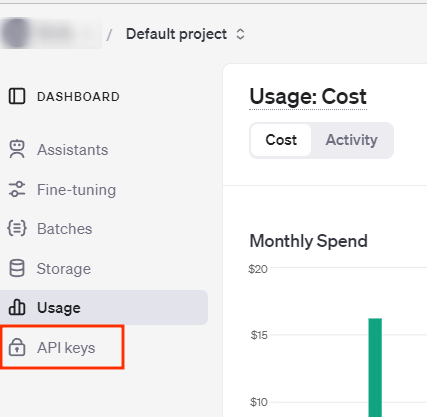

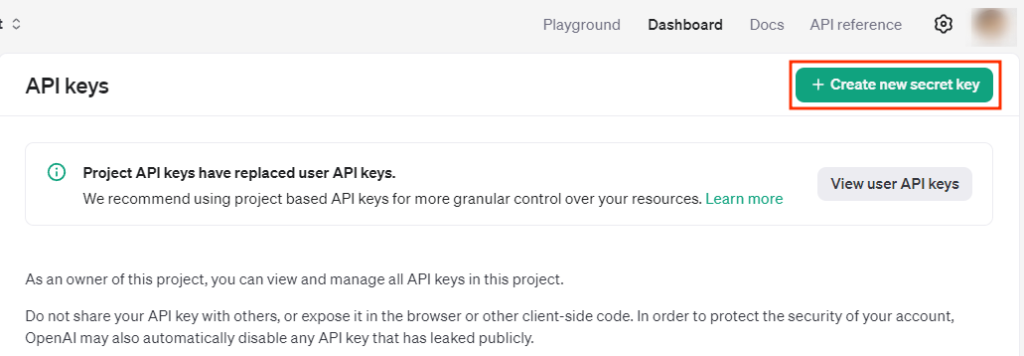

APIキーの取得方法

OpenAIのAPIを利用するには、まずAPIキーを取得する必要があります。

APIキーは、OpenAIの公式ウェブサイトでアカウントを作成し、ダッシュボードから取得できます。

OpenAIの公式サイトにアクセスし、アカウントを作成します。

ログイン後、ダッシュボードに移動し、「APIキー」セクションから新しいキーを発行します。

発行されたAPIキーは、後で使用するために安全な場所に保存してください。

同じAPIキーは再確認できないので、紛失した場合は既存のAPIキーを削除して再生成してください。

Pythonクライアントのインストール

OpenAIのAPIをPythonで利用するためには、OpenAIのPythonクライアントライブラリをインストールする必要があります。

以下のコマンドを使用してインストールを行います。

pip install openaiこのコマンドを実行することで、OpenAIのPythonクライアントがインストールされ、APIを利用する準備が整います。

環境設定と初期化

APIキーを取得し、Pythonクライアントをインストールしたら、次に環境設定と初期化を行います。

以下の手順で設定を行います。

- APIキーの設定: 取得したAPIキーを環境変数に設定します。

以下のようにコード内で直接設定することも可能です。

import openai

api_key = "YOUR_API_KEY"ここで、YOUR_API_KEYは取得したAPIキーに置き換えてください。

- クライアントの初期化: OpenAIクライアントを初期化します。

以下のコードを使用して、クライアントを設定します。

client = openai.OpenAI(api_key)これで、OpenAI o1モデルを利用するための準備が整いました。

クライアントを使用して、さまざまなAPIリクエストを行うことができます。

以上の手順で、OpenAI o1をPythonで利用するためのAPIの準備が完了します。

次のステップでは、具体的なAPIの使用方法について説明します。

OpenAI o1の基本的な使い方

OpenAI o1を利用するための基本的な使い方について説明します。

ここでは、クライアントの初期化、モデルの選択と設定、メッセージの送信と応答の取得について詳しく解説します。

クライアントの初期化

OpenAIのAPIを利用するためには、まずクライアントを初期化する必要があります。

以下のコードを使用して、クライアントを初期化します。

import openai

# APIキーを設定

api_key = "YOUR_API_KEY"

# クライアントの初期化

client = openai.OpenAI(api_key)ここで、YOUR_API_KEYは、事前に取得したAPIキーに置き換えてください。

この設定により、OpenAIのAPIにアクセスする準備が整います。

モデルの選択と設定

OpenAI o1には、o1-previewとo1-miniの2つのモデルが提供されています。

用途に応じて適切なモデルを選択し、設定します。

以下のコードでは、o1-previewモデルを選択しています。

# 使用するモデルを選択

model = "o1-preview"o1-previewは、幅広い一般知識を使用して難しい問題を推論できるように設計されています。

一方、o1-miniは、より高速で安価なモデルで、コーディングや数学、科学のタスクに適しています。

メッセージの送信と応答の取得

クライアントとモデルの設定が完了したら、次にメッセージを送信し、応答を取得します。

以下のコードは、ユーザーからのメッセージを送信し、モデルからの応答を取得する方法を示しています。

import openai

# APIキーを設定

api_key = "YOUR_API_KEY"

# クライアントの初期化

client = openai.OpenAI(api_key)

# 使用するモデルを選択

model = "o1-preview"

# メッセージを送信

response = client.chat.completions.create(

model=model,

messages=[

{

"role": "user",

"content": "Pythonでリストを逆順にする方法を教えてください。"

}

]

)

# 応答を取得

print(response.choices[0].message.content)このコードでは、ユーザーからの質問「Pythonでリストを逆順にする方法を教えてください。」をモデルに送信し、その応答を取得して表示しています。

実行結果として、Pythonでリストを逆順にする方法についての説明が返されます。

β版(2024/9/13時点)ではティア5のアカウントに制限されています。ティア4未満で使用してもエラーになるので注意してください。

例えば、list.reverse()メソッドやスライスを使用した方法が提示されるでしょう。

このようにして、OpenAI o1を利用して、さまざまな質問に対する応答を取得することができます。

応用例

OpenAI o1は、その高度な推論能力を活かして、さまざまな応用例に利用することができます。

ここでは、コーディングタスクの自動化、データ分析と推論、科学的な問題解決について具体的な例を紹介します。

コーディングタスクの自動化

OpenAI o1は、プログラミングの自動化において非常に有用です。

例えば、コードの生成やリファクタリング、バグの検出と修正などのタスクを自動化することができます。

import openai

# APIキーを設定

api_key = "YOUR_API_KEY"

# クライアントの初期化

client = openai.OpenAI(api_key)

# コーディングタスクの自動化例

response = client.chat.completions.create(

model="o1-preview",

messages=[

{

"role": "user",

"content": "Pythonでリスト内の重複を削除する関数を作成してください。"

}

]

)

print(response.choices[0].message.content)このコードは、Pythonでリスト内の重複を削除する関数を生成するようにモデルに依頼しています。

モデルは、setを利用した効率的な方法を提案するでしょう。

データ分析と推論

OpenAI o1は、データ分析においても強力なツールです。

データセットのパターン認識や異常検知、予測モデルの構築などに利用できます。

import openai

# APIキーを設定

api_key = "YOUR_API_KEY"

# クライアントの初期化

client = openai.OpenAI(api_key)

# データ分析の例

response = client.chat.completions.create(

model="o1-preview",

messages=[

{

"role": "user",

"content": "このデータセットから異常値を検出する方法を教えてください。"

}

]

)

print(response.choices[0].message.content)この例では、データセットから異常値を検出する方法をモデルに尋ねています。

モデルは、統計的手法や機械学習アルゴリズムを用いた異常検知のアプローチを提案するでしょう。

科学的な問題解決

OpenAI o1は、科学的な問題解決にも利用できます。

複雑な理論の説明や実験デザインの提案、データの解釈など、科学研究におけるさまざまなタスクを支援します。

import openai

# APIキーを設定

api_key = "YOUR_API_KEY"

# クライアントの初期化

client = openai.OpenAI(api_key)

# 科学的な問題解決の例

response = client.chat.completions.create(

model="o1-preview",

messages=[

{

"role": "user",

"content": "新しい抗生物質の研究において考慮すべき化合物を教えてください。"

}

]

)

print(response.choices[0].message.content)このコードは、新しい抗生物質の研究において考慮すべき化合物についてモデルに質問しています。

モデルは、最新の研究成果や化学的特性に基づいた化合物を提案するでしょう。

これらの応用例を通じて、OpenAI o1はさまざまな分野での問題解決に貢献できることがわかります。

ベータ版の制限事項

OpenAI o1は現在ベータ版として提供されており、いくつかの制限事項があります。

ここでは、利用可能な機能と制限、レート制限、ベータ版での注意点について説明します。

利用可能な機能と制限

ベータ版のOpenAI o1では、以下の機能が利用可能ですが、いくつかの制限があります。

- テキストのみのサポート: 現在、o1はテキスト入力のみをサポートしており、画像入力はサポートされていません。

- メッセージタイプの制限: ユーザーとアシスタントのメッセージのみがサポートされており、システムメッセージは利用できません。

- ストリーミング非対応: 応答のストリーミングはサポートされていません。

- ツールと関数呼び出しの制限: ツール、関数呼び出し、応答フォーマットのパラメータはサポートされていません。

- その他のパラメータ: temperature、top_p、nは固定されており、presence_penaltyとfrequency_penaltyは0に設定されています。

これらの制限は、ベータ版が終了次第、改善される予定です。

レート制限について

ベータ版のOpenAI o1には、レート制限が設定されています。

具体的には、20リクエスト/分(RPM)の制限があります。

この制限は、APIの安定性を確保するために設けられています。

- レート制限の影響: レート制限を超えると、リクエストが拒否される可能性があります。

大量のリクエストを送信する場合は、適切に間隔を空ける必要があります。

- 将来的な変更: 今後、レート制限は引き上げられる予定であり、より多くの開発者が利用できるようになる見込みです。

ベータ版での注意点

ベータ版を利用する際には、以下の点に注意が必要です。

- 機能の不安定性: ベータ版では、機能が不安定である可能性があります。

予期しない動作やエラーが発生することがありますので、重要なプロジェクトでの使用は慎重に行ってください。

- フィードバックの提供: ベータ版の利用中に問題が発生した場合や改善点がある場合は、OpenAIにフィードバックを提供することが推奨されます。

これにより、製品の改善に貢献できます。

- ドキュメントの確認: 最新の制限事項や機能については、OpenAIの公式ドキュメントを定期的に確認することが重要です。

これらの制限事項を理解し、適切に対応することで、OpenAI o1のベータ版を効果的に利用することができます。

まとめ

この記事では、OpenAI o1の概要からAPIの準備、基本的な使い方、応用例、ベータ版の制限事項までを詳しく解説しました。

OpenAI o1の高度な推論能力を活かすことで、コーディングタスクの自動化やデータ分析、科学的な問題解決において効果的な結果を得ることが可能です。

これを機に、OpenAI o1を活用して、より複雑なタスクに挑戦し、新たな可能性を探求してみてはいかがでしょうか。

![[Python] OpenAI Whisperの使い方 – 音声の文字起こし・翻訳処理](https://af-e.net/wp-content/uploads/2024/10/thumbnail-46985.png)

![[Python] OpenAI APIの使い方 – APIキー取得から結果の取得まで](https://af-e.net/wp-content/uploads/2024/10/thumbnail-46984.png)

![[Python] 日本語NLPライブラリGiNZAの使い方 – 日本語自然言語処理](https://af-e.net/wp-content/uploads/2024/10/thumbnail-46983.png)

![[Python] GPT-4oを使ってテキスト生成や画像入力する方法](https://af-e.net/wp-content/uploads/2024/08/thumbnail-27872.png)

![[Python] Geminiのapiを使う方法](https://af-e.net/wp-content/uploads/2024/08/thumbnail-27871.png)

![[Python] Claude3のAPIを使ってみる方法](https://af-e.net/wp-content/uploads/2024/08/thumbnail-27870.png)

![[Python] プログラムからChatGPTを呼び出す方法](https://af-e.net/wp-content/uploads/2024/08/thumbnail-27868.png)

![[Python] ChatGPTのAPIを使って何ができるのか紹介!](https://af-e.net/wp-content/uploads/2024/08/thumbnail-27866.png)

![[Python] ChatGPTのAPIを使う方法](https://af-e.net/wp-content/uploads/2024/08/thumbnail-27865.png)

![[Python] GPT4o-miniを試すコードを紹介!](https://af-e.net/wp-content/uploads/2024/08/thumbnail-27873.png)